한국어에 최적화된 LG 로컬LLM EXAONE

내 맘대로 많이 써도 추가 비용이 없는 LLM 모델 입니다.

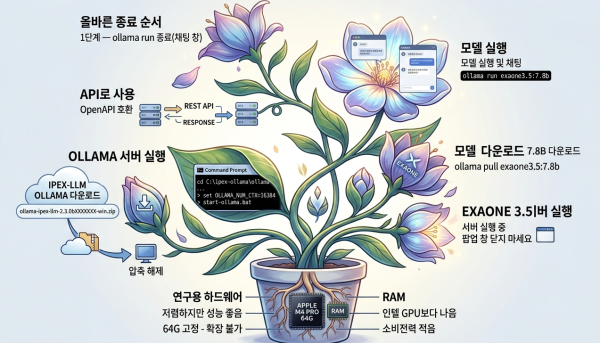

성능 좋게 사용하고 싶으면서 저렴하게 H/W 구매 하는 방법은 애플 M4 pro 64G를 사면 연구용으로 괜찮은 편에 들어갑니다.

인텔쪽 GPU 구매 하는것 보다 RAM 속도 때문에 좋고 소비전력도 적고 여러가지 면에서 좋은데 왜? 64G를 선택해야 하느냐는 자신의 상황에 따라 다르겠지만 이건 확장이 안되기 때문에 살때 높은것을 사야 합니다.

좀더 바르게 사용하고 싶으면: ASUS 어센션 GX10 구매 하면 됩니다.

● 전체 설치 순서

▷ IPEX-LLM Ollama Portable Zip 다운로드

https://github.com/ipex-llm/ipex-llm/releases

파일명 예시: ollama-ipex-llm-2.3.0bXXXXXXXX-win.zip

적당한 위치에 압축 해제 (예: `C:\ipex-ollama\`)

▷ Ollama 서버 실행

압축 해제 후 Command Prompt(명령 프롬프트)에서 start-ollama.bat 을 실행하면 별도 팝업 창이 뜨면서 서버가 시작됩니다.

cd C:\ipex-ollama

cd ollama-ipex-llm-2.3.0b20250725-win

아래는 별도의 창으로 뜨는것

set OLLAMA_NUM_CTX=16384

start-ollama.bat

팝업 창이 뜨면 서버가 정상 실행된 것입니다. **팝업 창은 닫지 마세요.**

▷ 모델 다운로드 및 실행

# EXAONE 3.5 7.8B (한국어 특화, 범용)

ollama pull exaone3.5:7.8b

▷ 다운로드 완료 후 바로 실행:

위에서 새로운 창이 떠 있어야 하고 로딩 하는데 컴퓨터에 따라 약간 걸릴 수 있다.

ollama run exaone3.5:7.8b

▷ API로 사용

서버가 실행 중인 상태에서 다른 터미널에서 REST API 형태로 호출이 가능하며 OpenAPI와 호환이 된다.

▷ 올바른 종료 순서

1단계 — ollama run 종료(채팅 중인 창)

/bye

2단계 — start-ollama.bat 팝업 창 종료

Ctrl + C

누른 후 팝업 창 닫기

→ X 버튼으로 그냥 닫으면?

프로세스가 백그라운드에 남음 - 메모리/GPU 점유 지속

다음 실행 시 포트 충돌

→ 만약 실수로 X 버튼으로 닫았다면

작업 관리자(Ctrl + Shift + Esc) → ollama.exe 찾아서 작업 끝내기

또는 명령 프롬프트에서: taskkill /f /im ollama.exe